Heft 3/2023 - Netzteil

„Nonhuman Minds“

Mit Kiki Kogelnik und WangShui zu einer politischen Kritik von KI

„Recent months have seen AI labs locked in an out-of-control race to develop and deploy ever more powerful digital minds that no one – not even their creators – can understand, predict, or reliably control“, heißt es im viel diskutierten (und kritisierten) offenen Brief des Future of Life Institute im März 2023, in dem zu einem Trainingsstopp von Künstlicher Intelligenz (KI) aufgerufen wird. Weiter wird gefragt: „Should we develop nonhuman minds that might eventually outnumber, outsmart, obsolete and replace us?“1

Hier soll es nicht um eine vollumfängliche Kritik des Briefs gehen, sondern um die Imagination und Historizität von „nonhuman minds“, wie sie darin propagiert werden. Konkret wird ein Dialog zwischen historischen und zeitgenössischen Diskursen sowie entsprechenden künstlerischen Positionen bemüht – insbesondere zwischen den Künstler*innen Kiki Kogelnik und WangShui auf der einen Seite und dem Begriff der KI und seiner politischen Kritik auf der anderen.

Das im Brief gemalte Bild einer dystopischen Zukunft kann als Propagierung einer dem Transhumanismus und Longtermism2 verpflichteten Philosophie gelesen werden. Und es erinnert an das, was Günther Anders in den 1950er-Jahren als „prometheische Scham“ bezeichnet hat: die Scham seitens des Menschen dafür, ein vermeintlich unzulängliches, „obsoletes“ und letztendlich sterbliches, kontingentes Wesen zu sein – ganz anders als die funktionalen, nützlichen, „perfekt“ gestalteten Maschinen. Dabei verändert die „beschämend“ hohe Qualität der eigenen Kreationen auch den Umgang mit dem Menschsein. In diesem konstatierten Anderssein liegt jedoch gleichzeitig auch eine Idee des Menschen entlang dem Bild der Maschine.3 Zunehmend „intelligente“ Maschinen verstellen also womöglich den Blick auf eine positive Selbstbestimmung des Menschen inmitten technologischer Entwicklungen. Dabei geht es nicht um eine romantische Vorstellung menschlicher Authentizität, sondern um eine produktive Auseinandersetzung mit dem Menschen in einer posthumanen Welt, in der die Grenzen, die den Menschen vormals als alleiniges, autarkes Zentrum positioniert haben, zunehmend unscharf werden.

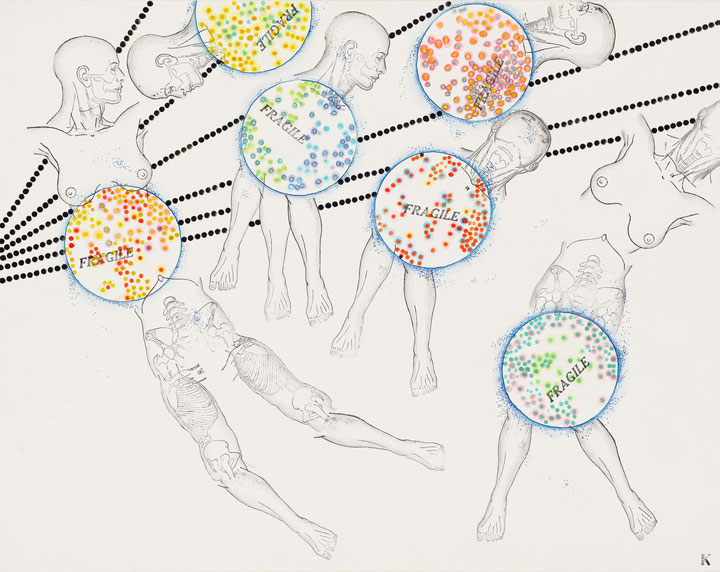

Anders’ Text erschien zu einer Zeit, als das menschliche Verhältnis zur Technik mit der Erfindung der Atombombe eine neue Dynamik annahm. Zum ersten Mal rückte die Selbstzerstörung der Menschheit durch die Technik in den Bereich des Möglichen – eine Potenzialität, die heute auch der KI zugeschrieben wird.4 Zudem war dies eine Zeit, in der sich der Weltraum als neue Sphäre auftat, in die der Mensch vorzudringen begann – gegenwärtig ist es die Sphäre des Virtuellen, die als von „digital minds“ bevölkert imaginiert wird. In diesem historischen Kontext thematisierte Kiki Kogelnik mit ihrem vielseitigen Werk immer wieder das sich wandelnde Verhältnis von Mensch, Technik und Maschine. Passend zu Anders’ Überlegungen zeigte sie beispielsweise menschliche Körper, die mit mechanisch-serieller Geste zerstückelt auf Papier gestempelt sind. Die in dem Bild Untitled (Robots) (ca. 1967) wie Vergrößerungsgläser wirkenden Kreise sind zudem mit der Aufschrift „fragile“ und zahlreichen bunten Fingerabdrücken versehen (Abb. 1).

Kogelniks Ansatz mag zunächst bunt und verspielt wirken, in ihren Arbeiten geht es aber auch um die eingehende Befragung der von der Technologie beförderten ideologischen und affektiven Projektionen. Ihre Space-Art-Phase in den 1960er-Jahren macht das besonders deutlich. Bombs in Love (1964) zeigt zwei aufrechtstehende Geschosshülsen, bunt bemalt mit gespreizten Beinen (Abb. 2). Sie erinnern eher an Raketen als an Bomben und sind ein Kommentar zur Technikeuphorie dieser Zeit, zur phallisch-männlich konnotierten Eroberungsmentalität, den Allmachtsfantasien und politisch unruhigen Zeiten. Während heute vor einer Auslöschung durch KI gewarnt wird, bekundet Bombs in Love die schon damals präsente Ambiguität eines technikgetriebenen Fortschrittsversprechens. Der sie selbst überragende Lover Boy (1963) zeigt darüber hinaus eine Besonderheit der Maschine gegenüber der Bombe (Abb. 3). Gefertigt aus Muffin- und Auflaufformen weist er zunächst auf die nach wie vor aktuelle Verbindung von vermeintlicher Automatisierung und oft invisibilisierter (Care-)Arbeit hin. Vor allem aber wird die Maschine – die bei Kogelnik eigentlich nur Skulptur ist – sogleich zur Projektionsfläche, einem anthropomorphen Gegenüber. Kogelnik in einem Interview: „I would like to have a robot who would say good morning, how beautiful you are, and I love you.“5 Anders als bei der Bombe verschwimmen bei der Vorstellung intelligenter Maschinen faktische und fiktive Entwicklungen – bei der von KI ausgehenden Bedrohung heute ebenso wie bei Kogelniks Karikatur der damaligen Technologie.

Kogelnik sieht die 1960er-Jahre „im Schwebezustand zwischen Zukunftsoptimismus, Pop, dem Gefühl, den Boden unter den Füßen zu verlieren, und dem Verlust von Körperlichkeit“, schreibt Alexandra Henning.6 Dabei ist die fehlende Bodenhaftung auch bei Kogelniks Maschinen auffällig, die Natur stellt eine markante Leerstelle in ihrem Werk dar. „I’m not interested in nature. That’s not important. I’ve always been more interested in machines“, sagt sie.7 Das Ausblenden der Natur und im weiteren Sinne der Umwelt ist (neben der Absage an das Körperliche) ein Motiv, das auch im Nachdenken über intelligente Maschinen wiederkehrt. Abgesehen von den cleanen Interfaces der KI-Technologien, hinter denen das sie ermöglichende Ausmaß an Ressourcen versteckt bleibt, geht es hier aber auch generell um die Produktionsverhältnisse, auf deren Boden KI steht.

Attributionsfehler

Die Imagination künstlicher Intelligenzen und der entsprechenden Gefahren geschieht häufig, ohne ihre politischen Implikationen mitzudenken, argumentiert Evgeny Morozov.8 Das Aufkommen überlegener Intelligenzen wird oft als unausweichlich in den Raum gestellt, als Gefahr und gleichzeitig als Lösung sozialer Probleme. Im Zuge eines „Techno-Solutionismus“ wird KI schon jetzt als Lösung zukünftiger Pandemien, der Inflation oder der Einsamkeitsepidemie verkauft. Diese neoliberale Argumentation zeigt auch, dass solche Technologien als zwangsläufig einer profitorientierten Marktlogik unterworfen betrachtet werden, was soziale Probleme aus der Sphäre der Öffentlichkeit verdrängt und in die des Markts verschiebt. Institutionen sollen sich dann nur noch „anpassen“, anstatt selbst transformative Agenden zu entwickeln. Für Morozov ist das eine zu kurz greifende Definition von Intelligenz: „Human intelligence is as much a product of policies and institutions as it is of genes and individual aptitudes.“ Welche Gefahr auch immer von „nonhuman minds“ zukünftig ausgehen mag, besteht eine solche heute schon in der mit ihnen zusammenhängenden neoliberalen, antisozialen Grundausrichtung.

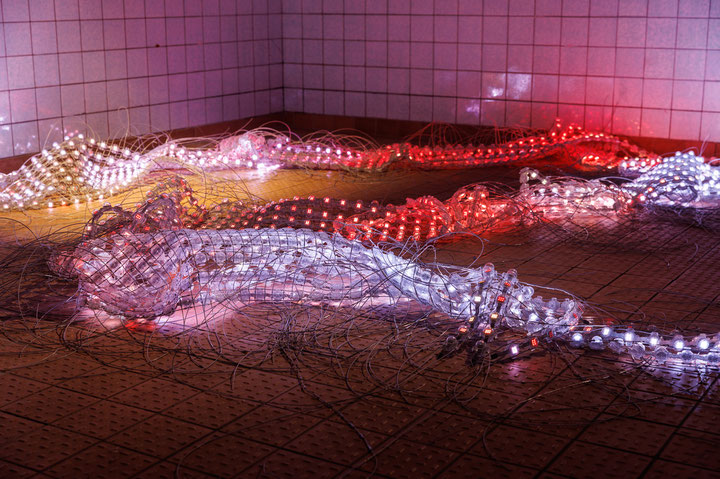

Exemplarisch zeigt sich die Vernachlässigung äußerer Faktoren in der Betrachtung von KI, wenn man WangShuis Werk Fundamental Attribution Error (2023) genauer betrachtet (Abb. 4). Die Skulptur ist nach dem sogenannten Attributionsfehler benannt, einem sozialpsychologischen Begriff, der das Unterschätzen des Einflusses von Umweltfaktoren auf das Verhalten eines Testsubjekts bezeichnet. Fundamental Attribution Error besteht aus einem auf dem Boden gewundenen LED-Gewebe, über das KI-generierte Farbverläufe flimmern. Das Lichternetz weckt Assoziationen mit abgeworfener Haut; die rhythmisch über die Skulptur zum Teil fließenden, zeitweise pochenden Farben provozieren die Suche nach Regelmäßigkeit und Intention. Die unbewegliche Skulptur hat etwas überraschend Lebhaftes. Wie bei Kogelniks Lover Boy sind auch hier die Projektionen der Rezipient*innen zentral. Ähnlich wie Alan Turings berühmter Test schon 1950 die Frage nach „denkenden“ Maschinen durch eine bestimmte Performanceanordnung in einem Gedankenexperiment ersetzte,9 hebt auch WangShuis Werk das nicht-menschliche Andere erst in Beziehung zu einem menschlichen Gegenüber hervor. Menschliche Arbeit, die beispielsweise in die verwendete KI-Technologie einfloss, wird im Zuge eines solchen Betrachtungsmodus zusehends verkannt.

Schlaglichter auf Umweltfaktoren und menschliche Arbeit eröffnen weitere historische Ausgangspunkte zum Nachdenken über KI. Im eingangs zitierten Brief ist eine künstliche Intelligenz etwas, das als „digital mind“ losgelöst von Körperlichkeit existiert bzw. auch von anderen Kontexten isoliert werden kann. Damit schreibt sich der Brief in die Traditionslinie einer mechanistischen Konzeption des Geists ein, die sich parallel zur Formierung von KI als Forschungsfeld und hier vor allem anhand des Aufstiegs des Konnektionismus in den 1940er- und 1950er-Jahren nachzeichnen lässt. Dabei hat sich im Denken über intelligente Maschinen ein elementarer Gegensatz herausgebildet: der symbolische und der konnektionistische Ansatz. Der Letztere (und heute erfolgreichere) reduziert „Intelligenz“ und „mind“ auf die physiologischen Verschaltungen im Gehirn, welche dann künstlich als neuronales Netz nachgebildet werden können. Diese zunächst als biologisch (und nicht sozial) fundiert gedachte Intelligenz und ihre konkrete Verortung im Gehirn sind stark durch positivistisches Denken geprägt. Das Füttern eines solchen Netzes mit Daten aus der jeweiligen Umwelt ist ausreichend für die Abbildung der Realität. Clemens Apprich argumentiert gegen eine solche Reduktion von „Intelligenz […] auf die Anatomie des Nervensystems“. Intelligenz sei kein „einheitliches Ding“, sondern selbst „äußerlich [nicht schlicht „im Kopf“ existierend, Anm. d. Autors] ein soziales Ensemble aus menschlichen und nicht-menschlichen Elementen“.10 „Künstliche“ Intelligenz ist insgesamt weniger künstlich als vielmehr kollektiv – also auch ein Abbild der Daten, mit denen sie von Nutzer*innen und Click Workern versorgt wird, sprich: Abbild eines „allgemeinen Wissens“, eines „general intellect“.

Der von Marx stammende Begriff des general intellect verdeutlicht das politische Moment: Er wirkt sich „nicht nur in der Form des Wissens, sondern als unmittelbare Organe der gesellschaftlichen Praxis“11 auf das Zusammenleben aus, das heißt, er ist selbst eine Produktivkraft. Die KI-Technologien, die als „nonhuman minds“ imaginiert werden, sind im Hinblick auf den Begriff des general intellect keine isolierbaren, von einem Außen abtrennbaren Entitäten, sondern gehen gerade darin auf. Und weil Marx den general intellect als Produktivkraft fasst, greift auch Morozovs Argument umso stärker: Als Produktivkraft ist er eingebettet in soziale Produktionsverhältnisse und begründet damit die gegenwärtige Produktionsweise, den digitalen Kapitalismus. Dieses Verhältnis birgt bestimmte Politiken, aber auch Möglichkeiten politischer Einflussnahme. Schon die Konzeption im Brief des Future of Life Institute als „nonhuman mind“ muss als eine solche gelesen werden. Selbige entsteht nicht in einem Vakuum, sondern speist sich aus gegenüber Arbeitsverhältnissen und Umweltfaktoren ignoranten Ideen. Eine politische Kritik von KI bedeutet demnach eine Umkehrung solcher Ideen, um den entfremdenden Aufgang „allgemeinen Wissens“ in „nicht-menschliche“ KI-Technologien zu fassen.12 Sie bedeutet, „nonhuman minds“ als Ergebnis von kollektiven, in politisch kontingente Prozesse eingebundenen, sozialen Verhältnisse zu verstehen.

[1] Pause Giant AI Experiments: An Open Letter, Future of Life Institute, 22. März 2023; https://futureoflife.org/open-letter/pause-giant-ai-experiments/

[2] Im Longtermism wird der Sorge um die ferne Zukunft und den dort wahrscheinlich existierenden Leben höchste moralische Priorität eingeräumt, was eine zu kritisierende Relativierung gegenwärtiger Probleme zur Folge hat.

[3] Günther Anders, Die Antiquiertheit des Menschen I. München: C. H. Beck 1956.

[4] Statement on AI Risk, Center for AI Safety, 30. Mai 2023; https://www.safe.ai/statement-on-ai-risk

[5] Kogelnik, zitiert nach Leroy F. Aarons, Nature? Pop Artist Not Interested, in: The Washington Post, 10. Dezember 1964, S. 44.

[6] Alexandra Henning, Kiki Kogelnik. Roboterfantasien oder wie die Bomben zu lieben lernten, in: Hans-Peter Wipplinger (Hg.), Kiki Kogelnik. Retrospektive. Kunsthalle Krems/Verlag für Moderne Kunst, 2013, S. 34–45, hier S. 38.

[7] Siehe Anm. 5.

[8] Evgeny Morozov, The True Threat of Artificial Intelligence, in: The New York Times, 30. Juni 2023; https://www.nytimes.com/2023/06/30/opinion/artificial-intelligence-danger.html

[9] Alan Turing, Computing Machinery and Intelligence, in: Mind, New Series, 59(236), 1950, S. 433–460.

[10] Clemens Apprich, Die Maschine auf der Couch. Oder: Was ist schon „künstlich“ an Künstlicher Intelligenz? in: Zeitschrift für Medienwissenschaft, 11(2), 2019, S. 20–28, hier S. 28.

[11] Karl Marx, Grundrisse der Kritik der politischen Ökonomie. Rohentwurf 1857–1858. 2. Aufl., Dietz, 1974, S. 594.

[12] Matteo Pasquinelli, On the origins of Marx’ general intellect, in: Radical Philosophy, 2.06, Winter 2019, S. 43–56, hier S. 54.